ChatGPTに個人情報を入力しても本当に大丈夫?

ChatGPTを使い始めた多くの人が最初に不安に感じるのが、個人情報を入力してしまっても問題ないのかという点です。

結論から言うと、ChatGPTは個人情報の入力を前提としたサービスではなく、基本的には個人情報を入力しない使い方が推奨されます。

ただし、入力内容を工夫すれば、リスクを抑えながら活用することも可能です。

この章では、なぜ個人情報の入力が推奨されないのか、どのような場合なら比較的安全に使えるのか、その判断基準を整理します。

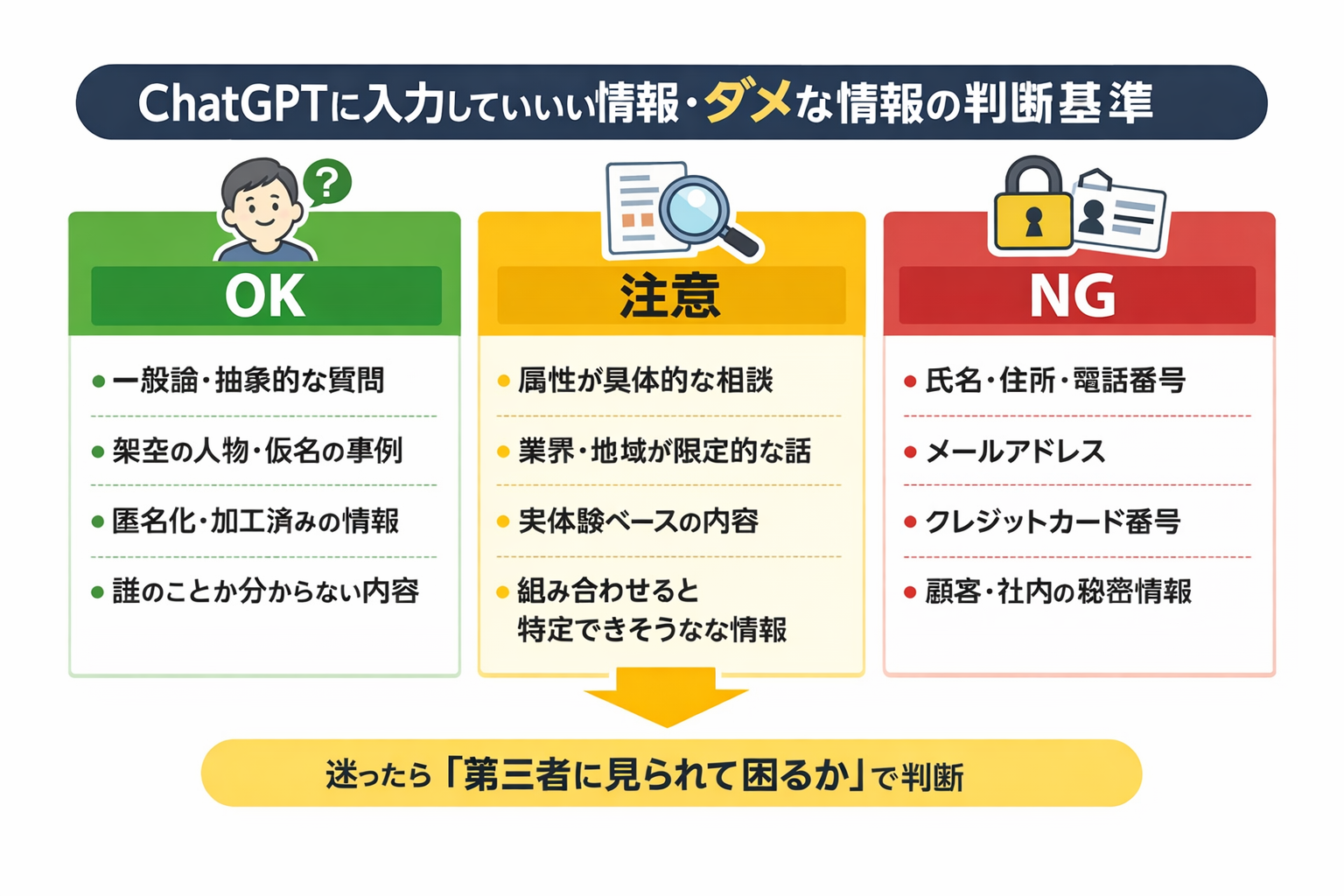

◼︎入力判断のポイント

- 個人情報は原則入力しない

- 加工すれば使えるケース

- 安全性は使い方次第

結論、個人情報の入力は基本的に避けるべき

結論として、ChatGPTに個人情報をそのまま入力する行為は避けるべきです。なぜなら、ChatGPTは個人情報を安全に管理するための専用システムではないからです。

氏名や住所、電話番号などを入力してしまうと、意図しない形でデータとして扱われる可能性を完全には否定できません。多くの人が誤解しがちですが、「便利だから」「すぐ消える気がするから」という理由で入力するのは危険です。

ChatGPTは検索フォームではなく、会話内容を処理するAIである点を理解する必要があります。個人情報を入力しない前提で使うことが、最も安全でシンプルな使い方です。この前提を守るだけでも、情報漏洩リスクは大きく下げられます。「入力しない」という選択自体が最大の対策だと覚えておきましょう。

特定できない形に加工すれば使える場合もある

一方で、すべての情報が完全にNGというわけではありません。個人が特定できない形に加工すれば、ChatGPTを安全に活用できるケースもあります。

たとえば、実名を使わずに「A社」「Bさん」と置き換える、具体的な日付や住所を削除する、年齢を「30代」など幅を持たせて表現するといった方法です。こうした工夫によって、個人特定リスクを大きく下げることが可能です。

重要なのは、入力した文章を第三者が見たときに「誰の話か分かるかどうか」という視点です。分からない形まで加工できていれば、ChatGPTの利便性を活かしつつ、リスクを抑えた利用ができます。そのまま入力するのではなく、加工してから使う。これが安全に使うための現実的な折衷案です。

安全性は入力内容と使い方で決まる

ChatGPTの安全性は、サービスそのものよりも利用者の入力内容と使い方で決まります。どんなに優れたAIであっても、使い方を誤ればリスクは高まります。逆に言えば、入力ルールを明確に決めていれば、過度に恐れる必要はありません。

「これは第三者に見られても問題ないか」「会社や本人に不利益が出ないか」。この2点を基準に考えるだけで、判断はかなり楽になります。ChatGPTを安全に使うコツは、完璧な安全を求めるのではなく、危険な使い方を避けることです。この考え方をベースにすれば、日常利用でも業務利用でも、無理なく活用できます。

ChatGPTではどこまでの情報が「個人情報」に該当する?

ChatGPTを使う上で混乱しやすいのが、「どこからが個人情報なのか分からない」という点です。個人情報というと、氏名や住所だけを思い浮かべがちですが、実際にはそれだけではありません。個人が特定できるかどうかが判断基準になります。

この章では、「単体でアウトな情報」「組み合わせでアウトになる情報」「名前がなくても注意が必要な情報」の3つに分けて整理します。

◼︎個人情報の判断基準

- 単体で特定できる情報

- 組み合わせで特定できる情報

- 推測で特定できる情報

氏名や住所など単体で個人が特定できる情報

氏名、住所、電話番号、メールアドレス。これらは、単体で個人が特定できる典型的な個人情報です。ChatGPTに入力する情報としては、最も分かりやすくNGな部類に入ります。

「一部だけなら大丈夫だろう」「下の名前だけなら問題ないだろう」そう考える人も多いですが、他の情報と結びつけば特定につながる可能性があります。特に、実在する人物、顧客、取引先に関する情報は、入力しないのが基本です。単体で分かる情報は迷わず避ける。これが最初の判断基準になります。

複数の情報を組み合わせると個人が特定できる情報

一つ一つは問題なさそうに見えても、複数の情報を組み合わせると、個人が特定できてしまうケースがあります。たとえば、「30代男性」「東京都在住」「特定の業界で働いている」といった情報が重なると、該当人物がかなり絞られることがあります。

本人は匿名のつもりでも、第三者の視点では十分に個人情報です。特に、業務相談、トラブル相談、人事や評価に関する内容は要注意です。組み合わせで特定できる時点で個人情報扱い。この意識を持つことが重要です。

名前がなくても本人が推測できる情報

名前を書いていなくても、本人が推測できる情報は個人情報に該当します。たとえば、「社内で一人しかいない役職」「特殊な経歴」「具体的な出来事や日時」などが含まれていると、関係者には誰のことか分かってしまう可能性があります。

ChatGPTに入力する際は、不特定多数が見ても分からない内容になっているかを基準にしましょう。名前がない=安全ではない。これを理解しておくだけで、リスクは大きく下がります。

ChatGPTに入力した情報は学習データとして使われる?

ChatGPTに入力した内容が、学習データとして使われるのかどうか。これは多くの人が気にするポイントです。結論としては、条件や設定によって扱いが変わるというのが正確な答えです。この章では、誤解されやすいポイントを整理しながら、正しい理解を解説します。

◼︎学習に関する理解

- 学習される可能性

- 学習を避ける方法

- 安全との違い

条件によっては学習に使われる可能性がある

ChatGPTでは、入力内容がサービス改善のために利用される可能性があります。ただし、すべての入力が無条件に学習されるわけではありません。利用形態や設定によって扱いは異なります。

重要なのは、「絶対に学習されない」と思い込まないことです。個人情報を入力しない前提で使う理由はここにもあります。学習される可能性がゼロではない以上、入力は慎重に。この姿勢が基本になります。

学習に使われにくくする設定や使い方はある

ChatGPTには、学習利用を制限する設定や利用方法があります。これを活用すれば、リスクを下げた使い方は可能です。ただし、設定をしたからといって、何を入力しても安全になるわけではありません。設定はあくまで補助的なものです。入力しない運用とセットで考えることが重要です。

学習されない=安全とは限らない

よくある誤解が、「学習されないなら安全」という考え方です。学習と安全性は、必ずしもイコールではありません。保存、ログ、運用上の扱いを考慮すると、個人情報を入力しないという判断は変わりません。学習設定に関係なく慎重に使う。これが現実的な結論です。

ChatGPTに入力した個人情報は保存・共有される?

ChatGPTのデータは、完全にその場で消えるものではありません。この点を理解していないと、思わぬリスクにつながります。ここでは、保存と共有の考え方を整理します。

◼︎保存と共有

- 保存の可能性

- 共有の考え方

- 利用者の注意点

入力データは一定期間保存される可能性がある

ChatGPTでは、入力内容が一定期間保存される可能性があります。そのため、「すぐ消えるだろう」という前提で使うのは危険です。保存される可能性がある以上、個人情報は入力しない。これが一貫した判断になります。保存されても困らない内容だけを入力する。これが安全な使い方です。

原則公開されないが完全非共有ではない

ChatGPTの入力内容が、そのまま公開されるわけではありません。ただし、完全に第三者と無関係とは言い切れない点は理解しておく必要があります。だからこそ、機密情報や個人情報は入力しないのが基本です。

日本利用でも機密情報は避けるべき

「日本で使っているから安全」「個人利用だから大丈夫」そう考えるのは危険です。利用場所に関係なく入力内容が重要です。日本ユーザーであっても、機密情報は入力しない。この原則は変わりません。

ChatGPTを安全に使うための現実的な使い方とは?

ChatGPTは、正しく使えば非常に便利なツールです。重要なのは、危険をゼロにしようとしないこと。現実的な線引きを持って使うことです。

◼︎安全に使う考え方

- 入力しない基準

- 判断の物差し

- 習慣化

個人特定情報を入れない線引きが現実解

最も分かりやすい線引きは、個人が特定できる情報は入力しないというルールです。これを守るだけで、大半のリスクは回避できます。

第三者に見られて困るかで判断する

迷ったときは、「これを第三者に見られて困るか」という視点で判断しましょう。困るなら入力しない。この単純な判断基準が最も実用的です。

安全な使い方を習慣化する

安全な使い方は、一度決めて終わりではありません。日常的に意識し、習慣として定着させることが重要です。ルールを守ることが最大のセキュリティです。

ChatGPTの利便性は理解していても、いざ業務導入となると「個人情報」や「機密保持」の壁に直面しがちです。弊社では、貴社の業務内容に合わせた安全な活用ガイドラインの策定や、リスクを最小限に抑える導入支援を行っています。

「自社のルールが今のままでいいのか不安」「安全に、かつ最大効率でAIを使いこなしたい」という担当者様は、ぜひ一度お気軽にご相談ください。